動画生成AIのツールが、ここ一年で急速に増えました。試してみた、という方も多いのではありませんか?

私自身もいろいろ試してみました、非常に「面白い」と感じます、ただ「使える」は、別の話なのかなと思っていました。業務で使うとなれば、クオリティが安定して出るのか、権利の問題はないのか、コストはどう管理するのか、そして継続して運用できるのか——

そこで、現状のモデルを使用して、業務に使用できる可能性がどのくらいのあるのかについて、実際の映像の仕事をしている人間の目線で評価していきたいと思います。

クラウドとローカル——今回ローカルを選んだ理由

動画生成AIには、クラウドサービスを使う方法と、ローカル環境で動かす方法があります。

それぞれの特性については下記の記事で整理しましたが、今回はローカル生成の検証をしていきたいと思います。その理由を、あらためて整理しておきたいと思います。

①トライ&エラーとコスト

一つ目は、トライ&エラーのコスト構造です。

クラウドサービスでは、生成のたびにクレジットを消費します。試行回数が増えるほど費用がかかり、検証作業のコストが読みにくくなります。ローカルでは、電力と時間は消費しますが、クレジットは発生しません。

実務レベルで繰り返し検証するには、この違いは小さくないと感じています。

②どこまでカスタムできるのか(柔軟性)

もう一つが、LoRAを使えることです。

LoRAとは、モデルに特定のスタイルや人物・動きのパターンを学習させる、軽量な追加モジュールのことです。

これを組み込むと、出力の方向性をある程度自分でコントロールできるようになります。クラウドサービスでは、基本的にこれができません。

コストの柔軟性と、制御の自由度。

この二点により、今回の検証はローカルで行えるモデルを選定することにしました。

モデルの選定——LTX-2.3を選ぶ理由

検証用の映像のテーマは「人物描画」を設定しました。

その理由として、人物を使った映像素材を作ろうとすると、撮影の手配、モデルへの出演依頼、肖像権の処理といったコストと手続きが発生します。

AI生成であれば、これらをある程度回避でき、製品紹介映像のカット素材や、説明動画の補助映像として人物が動く素材が生成できるということのメリットが非常に大きいと感じた為です。

実際のモデルは、先の2つの要件を満たすものとして、LTX-2.3を選定しました。理由は主に三点あります。

ライセンスが明確であること。

LTX-2.3はLightricks社が公開するオープンソースモデルで、

年間売上が10M USD(目安として約15億円)未満の組織であれば、商用利用が可能です。

これを超える規模の場合は、別途ライセンス契約が必要になります。

LoRAに対応していること。

公式のトレーニングツールも提供されており、

スタイルや人物の一貫性を学習させたLoRAを、自分で作成・適用できます。

ComfyUIにネイティブ対応していること。

ワークフローを組みやすく、出力フォーマットも多くのカスタムノード資産により既存のCG制作環境とも連携できる可能性が考えられます。(条件さえ整えば自作することも可能)

以上の条件で、LTX-2.3で「どこまでできるか、どこが限界か」を検証していきたいと思います。

また、他のモデルと並べて優劣を比較する記事ではない、という点はあらかじめお伝えしておきます。

実務フロー — Z-Image TurboからLTX-2.3 I2Vへ

生成において使用するワークフローは、I2Vを基本としました。

Z-Image Turboでスタートフレームとなる静止画を生成し、それをLTX-2.3のI2V(Image to Video)に渡して動画を生成する、という流れです。

なぜT2VではなくI2Vなのか

動画生成には大きく二つのアプローチがあります。テキストプロンプトだけから動画を作るT2V(Text to Video)と、静止画を起点として動画を生成するI2V(Image to Video)です。

T2Vはシンプルですが、構図・照明・人物の表情といった要素の制御が難しく、「意図した絵」が出てくるかどうかは、かなり試行に依存します。

I2Vは、スタートフレームとなる静止画の時点で、構図・ライティング・被写体の状態をある程度固定できます。

構図や形状を先に決める事ができますので、出発点を固定することができます。無限にガチャを行う必要も有りませんし、テイストやクオリティを事前に確認できますので、業務として使用する場合は、必須と考えます。

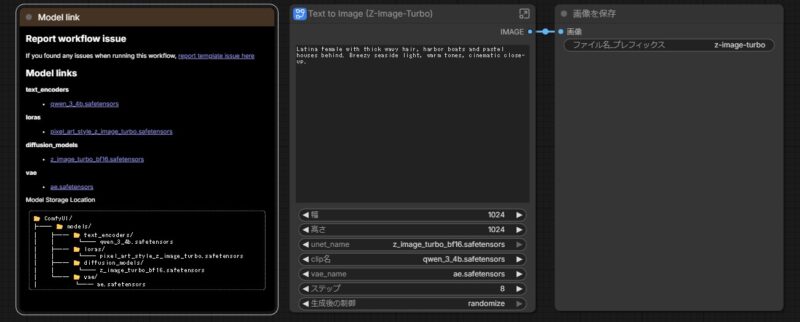

Z-Image Turboを使う理由

スタートフレームの生成には、Z-Image Turboを使います。Alibaba Tongyi Labが開発したオープンソースの画像生成モデルで、Apache 2.0ライセンスのもと商用利用が可能です。

10ステップ程度の比較的少ないステップでの高速生成が可能で、フォトリアル系の画像品質が高く、ComfyUI上での運用にも向いています。人物の肌質・髪の細部・衣服の質感といった要素もある程度再現できるため、スタートフレームとしての品質を確保しやすい、と感じています。

スタートフレームの品質は、動画クオリティの上限を決めます。粗い静止画から始めれば、動画も粗くなります。ここに手をかける価値は、十分にあります。

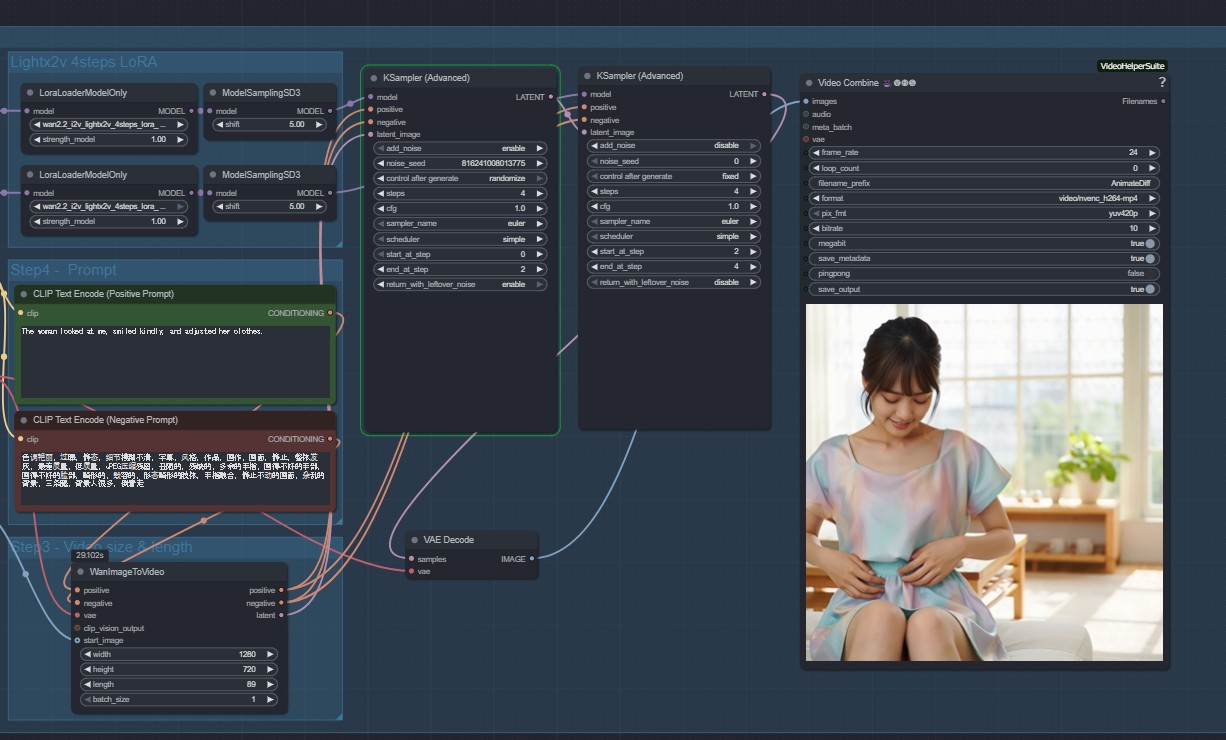

制作の流れ

ワークフローは以下のようになります。

【1】Z-image-turboでの静止画生成(スタートフレーム用)

ComfyUIのテンプレート(Z-Image-Turboテキストから画像へ)のワークフローを使用します。

解像度は、1280*720、または1920*1080(1920*1088)を指定します。

画像が安定しない場合は、1328*1328の解像度で生成し、photoshop等を用いて、動画用のアスペクト比、解像度に調整します。スタートの画質が後のクオリティを左右しますので、イメージに近いものになるように生成します。

【2】LTX-2.3のi2vで動画生成

ComfyUIのテンプレート(LTX-2.3:画像から動画へ)のワークフローをカスタム(LoRAが複数使用できるようにします)して使用します。

解像度は、1920*1088が理想ですが、使用するGPUのメモリを考慮し、1280*720等の解像度を使用してください。

弊社環境ではRTX3090を使用し、1920*1088で600フレームの生成が可能でした。

【3】AfterEffectsで色調整、フォーマットの変換を行う

生成された動画の解像度を1920*1080に整えます。また素材を繋いだり、色調整を行ったりというこれまでの映像編集・加工を行います。

テロップなどが必要な場合は、この工程で付与するのが現状では最適と思います。

クラウド生成と比べると生成時間はかかりますが、クレジットを気にせず再生成できる点や、これまでの業務に近い環境で業務が行える安心感はあると感じています。

クオリティを左右する要因

スタートフレームの作り込み

先に述べたように、スタートフレームの品質が動画の仕上がりを大きく左右します。

特に人物描画では、表情・視線・姿勢の自然さが、そのまま動画に引き継がれます。

Z-Image Turboは、フォトリアルに近い画像を生成できます。このモデルで作ったスタートフレームをI2Vに渡すことで、動画全体のトーンを自分でコントロールしやすくなります。

今回は以下の画像を使用します。

young Japanese woman in a summer yukata sitting on the edge of a wooden engawa, facing outward to a Japanese garden

wide shot, full body, showing the engawa and garden space

legs hanging down naturally from the engawa, relaxed posture

gentle summer breeze moving her hair and sleeves

hands resting naturally on her lap, empty

warm late afternoon sunlight, photorealistic, no anime style, no objects in hands

プロンプトの書き方

LTX-2.3はテキストエンコーダーが前バージョンから大きく拡張され、 プロンプトへの追従性が改善されています。公式のガイドラインでは、箇条書きではなく自然な流れのある一段落として書くことが推奨されており、 動作・被写体の特徴・環境・音の描写を4〜8文でまとめるのが基本とされています。

ただし、カメラワークの指示については、実際に使ってみると話が変わってきます。

「slow dolly in」「camera tracks left」といった記述は、 確かにまったく動きがないよりは何かしらの変化を生むことがあります。 一方で、意図した通りのカメラ動作が再現されるかというと、 現状では精度が安定しているとは言いにくいというのが率直な印象です。

コミュニティの報告でも、プロンプトでのカメラ指定は動きを「促す」程度の効果にとどまり、 正確なコントロールには専用のカメラLoRAが必要、という見解が出ています。

プロンプトは現在時制の動詞で書き、シーンが今起きているように描写するのが基本です。

感情ラベル(”she feels nervous”)より身体的な手がかり(”her hands grip the edge of the table”) の方が、出力に反映されやすいとされています。

まとめると、被写体の動きはプロンプトで方向を出しやすい。 カメラの動きは、現時点ではプロンプトだけで意図通りに制御することは難しく、 LoRAや複数回の生成と選別を前提として考えた方が、実務での運用に合っています。 これも、この技術の「今の限界」の一つだと思っています。

A young Japanese woman sitting on an engawa, relaxing quietly.

She slightly adjusts her posture and slowly turns her head, eventually looking toward the camera with a calm expression. A gentle breeze moves her hair and sleeves softly.

The camera is mostly static with a very subtle slow push-in.

A young Japanese woman sitting on an engawa, relaxing quietly.

She slowly turns her head and gradually looks toward the camera, forming a gentle natural smile. A soft breeze moves her hair and sleeves.

The camera slowly moves closer to her upper body with a subtle cinematic push-in.

編集後の映像

ライセンスとリスク——使う前に確認すること

業務利用を考える際に、ライセンスはとても重要です。

Z-Image TurboはApache 2.0ライセンスで、商用利用が可能です。

LTX-2.3はLTX-2 Community License Agreementのもとで公開されています。年間売上10M USD未満の組織であれば商用利用が可能ですが、それを超える規模の場合はLightricksとの別途ライセンス契約が必要です。

規模の大きいクライアントのプロジェクトに使う場合は、事前に確認が必要になります。

生成コンテンツの権利については、現状として明確な法的判例が少ないのが実態です。

各モデルのライセンスに「生成コンテンツの権利は利用者に帰属する」と書かれていても、それが著作権として保護されるかどうかは、国や状況によって判断が異なります。

日本では、AIが自律的に生成したコンテンツには著作権が認められないとする見解が主流ですが、人間の創作的関与がどの程度あったかによって、判断が変わる可能性もあります。

また、生成された人物画像に実在の人物の特徴や肖像権を侵害する要素が含まれていないかの確認は、利用者側の責任となります。商用利用可のシステムを使っていても、生成されたコンテンツが既存の権利に抵触するかどうかは、

また別の問題です。

大手クライアントの案件や広告への使用では、現時点では慎重な判断が求められると思っています。

考察——どの分野で、どのように使えるか

テイストの幅を広げる

人物描画のスタートフレームは、写実系に限りません。

たとえば、Nano Banana 2(Googleの画像生成モデル)を使えば、アニメ調やクレイアニメ的なテイストのスタートフレームを生成できます。そこからLTX-2.3でI2Vを行うことで、2Dアニメ風や柔らかい立体感のある映像を出すことも可能です。スタートフレームさえ整えれば、同じワークフローのまま、幅広い表現テイストに対応できると感じています。

なお、Nano Banana 2の商用利用には有料プランへの加入が必要ですので、ご利用の際はご確認ください。

一貫性を求めるなら、LoRAが必要になる

複数のカットを通じて同じ人物が登場する映像、 たとえば、製品紹介の複数シーンで同じモデルが使われるケースでは、プロンプトと画像の組み合わせだけでは、顔や体形が微妙にずれていきます。

この一貫性の問題を解決するには、LoRAが必要です。LoRAはai-toolkit(Ostris製、Apache 2.0ライセンス)で作成できます。特定の人物を学習させ、そのLoRAをワークフローに組み込むことで、カットをまたいだ一貫性をある程度担保できるようになります。

ただし、LoRAの作成にはGPUメモリが必要で、VRAM 24GBが現実的な最低ラインになります。

環境が整っていない場合は、まずトライ&エラーの段階から始めるのが現実的です。

結論——補助素材としての活用が、現状の着地点

LTX-2.3を使ったI2V動画生成が業務で活用できるか、という問いに対しては、「活用できる」と考えています。

ただし、現時点での適切な位置づけは「補助的な動画素材」だと思っています。

メインビジュアルとしての運用や、クライアントワークの主軸素材にするには、品質の安定性とリスクの整理がまだ追いついていない部分があります。

一方、説明映像の一部に短い人物モーション素材を加える、Webコンテンツの背景に動きのある素材を使う、制作初期の絵コンテ的な用途で使う、こういった活用であれば、現状でも実務に組み込む価値があると感じています。

ノウハウを積み上げながら、技術の発展を観察しつつ、運用範囲を少しずつ広げていく。

それが今この段階での、最適な向き合い方ではないかと考えています。

正直に言えば、この分野の進化は本当に速いと感じています。

半年前に「難しい」と感じていたことが、今はすでに当たり前になっています。

次の半年も、きっとそうなるでしょう。

楽しみながら待つ——というのが、本音です。

まとめ

今回は、Z-Image TurboとLTX-2.3を組み合わせたI2Vワークフローを構築し、業務利用の可能性を検証しました。

ライセンスが整っていて、LoRAで制御できて、ComfyUI上で動く。このワークフローは、現時点でも実務に組み込める条件を備えていると思っています。ただし、メインビジュアルではなく補助素材として使いながら知見を積み上げていく、というスタンスが、現実的な出発点です。

フィジカルアイでは、こうした検証を継続しながら、実際の制作現場で使えるかどうかを自分たちの目で確かめていきます。「使える」と言えるようになるまでにはまだ距離がありますが、その距離は確実に縮まっています。

FAQ

石水修司 株式会社フィジカルアイ代表/Adobe Community Expert

ベーマガに熱中した少年時代から、ベータカム時代の映像制作を経て、現在は3DCG制作のプロとして生成AI技術を活用した映像表現を手がけている。

Lancer of the Year 2016、CGWORLD「CGごはん」選外優秀賞。今治市在住。